Source

Jaźwińska, K., & Chandrasekar, A. (2025, 6 mars). We Compared Eight AI Search Engines. They’re All Bad at Citing News. Columbia Journalism Review. https://www.cjr.org/tow_center/we-compared-eight-ai-search-engines-theyre-all-bad-at-citing-news.php

Repéré via

Columbia Journalism Review : https://www.cjr.org

Résumé

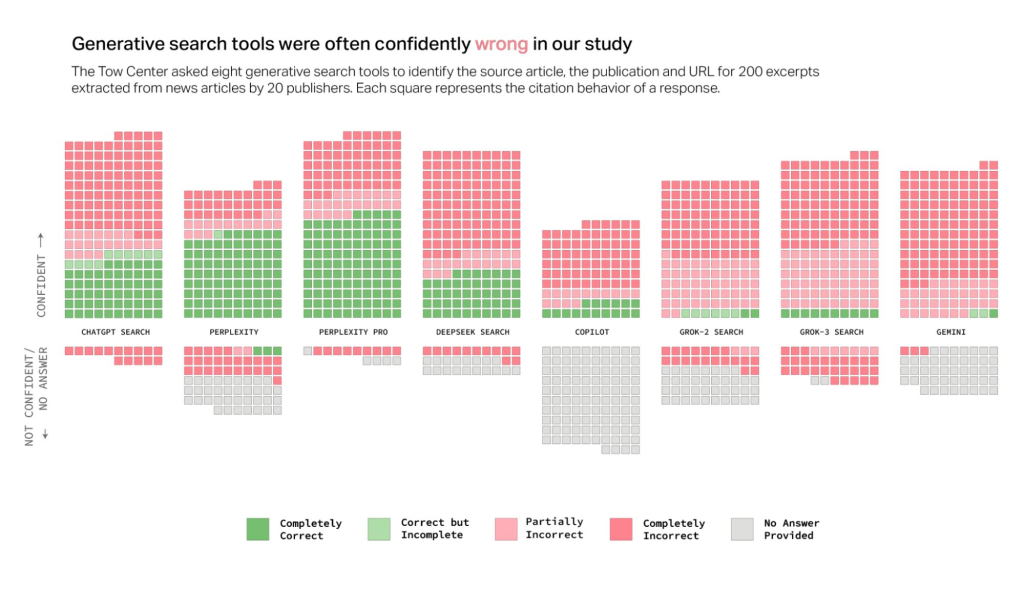

Le Tow Center for Digital Journalism a évalué huit moteurs de recherche alimentés par l’IA, dont ChatGPT Search, Perplexity, DeepSeek Search, Copilot de Microsoft, Grok de xAI et Gemini de Google. L’étude révèle que ces outils échouent fréquemment à citer correctement les sources d’actualités, allant jusqu’à fournir des informations erronées ou inventées, même lorsqu’ils disposent de partenariats de licence avec des éditeurs.

Points clés

- Méthodologie rigoureuse : 1 600 requêtes ont été soumises à huit moteurs de recherche IA, en utilisant des extraits d’articles provenant de 20 éditeurs de presse.

- Résultats préoccupants : Les outils testés ont souvent fourni des réponses incorrectes ou incomplètes, avec des citations erronées ou absentes.

- Problèmes de conformité : Certains moteurs ont ignoré les directives des fichiers robots.txt, accédant à des contenus que les éditeurs souhaitaient restreindre.

- Impact sur les éditeurs : La mauvaise attribution des sources peut nuire à la visibilité et à la crédibilité des éditeurs de presse.

Valeur ajoutée pour l’éducation

Cette étude souligne l’importance d’enseigner aux apprenants à évaluer de manière critique les informations fournies par les outils d’IA. Les éducateurs doivent sensibiliser les élèves aux limites de ces technologies, notamment en matière de fiabilité des sources et de vérification des informations. Intégrer des modules sur la littératie numérique et la vérification des faits dans les programmes éducatifs devient essentiel à l’ère de l’IA.